Идентификационное представление системы

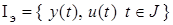

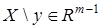

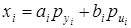

Так как в большинстве случаем размерность выхода системы  намного меньше размерности вектора состояния

намного меньше размерности вектора состояния  динамической системы, то есть

динамической системы, то есть  , то на основе информационного множества

, то на основе информационного множества  нельзя идентифицировать параметры системы. Для использования множества

нельзя идентифицировать параметры системы. Для использования множества  в системах идентификации уравнение необходимо привести к специальному виду, который получил название наблюдателя.

в системах идентификации уравнение необходимо привести к специальному виду, который получил название наблюдателя.

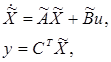

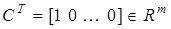

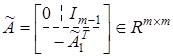

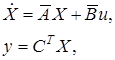

Рассмотрим динамическую систему

(1)

(1)

где  — вектор состояния,

— вектор состояния,  ,

,  — вход и выход системы,

— вход и выход системы,  ,

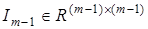

,  ,

,

,

,

— единичная матрица,

— единичная матрица,  — вектор параметров.

— вектор параметров.

Для системы (7.1) известна информация

. (2)

. (2)

Предполагается, что система (1) является полностью наблюдаемой и управляемой.

Для идентификации системы (1) на множестве  ее уравнение следует привести к канонической идентификационной форме. Так как матрица С является вектором, то состояние системы (1) не может быть однозначно определено на множестве

ее уравнение следует привести к канонической идентификационной форме. Так как матрица С является вектором, то состояние системы (1) не может быть однозначно определено на множестве  , поскольку существует множество систем, имеющих идентичные выходы

, поскольку существует множество систем, имеющих идентичные выходы  при входном воздействие

при входном воздействие  . Все системы этого класса получаются с помощью преобразования

. Все системы этого класса получаются с помощью преобразования

с матрицей  , удовлетворяющей уравнению

, удовлетворяющей уравнению

, (3)

, (3)

а система (1) приводится к виду

(4)

(4)

где  ,

,  .

.

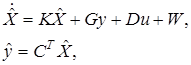

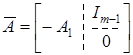

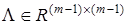

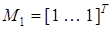

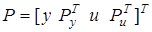

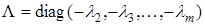

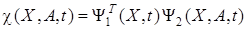

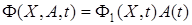

Для восстановления компонент вектора X, элементов матриц  ,

,  применим модель

применим модель

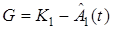

(5)

(5)

где  ,

,  — гурвицева матрица,

— гурвицева матрица,  ,

,  ,

,  ,

,  .

.

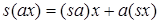

Необходимость перехода от уравнения (1) к (2) связана со структурой множества  . Уравнение (5) называется канонической идентификационной формой. Существует большое разнообразие канонических форм для системы (1). Наиболее общими из них являются матричные модели Ганкеля и Безу. Матрица преобразования S для этих моделей индуцируется матрицей Ганкеля и представима в виде произведения матриц достижимости и наблюдаемости. Что касается канонической формы для матриц

. Уравнение (5) называется канонической идентификационной формой. Существует большое разнообразие канонических форм для системы (1). Наиболее общими из них являются матричные модели Ганкеля и Безу. Матрица преобразования S для этих моделей индуцируется матрицей Ганкеля и представима в виде произведения матриц достижимости и наблюдаемости. Что касается канонической формы для матриц  и K в (4), (5), то они должны выбираться из следующих условий.

и K в (4), (5), то они должны выбираться из следующих условий.

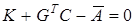

К1. Уравнение

должно быть разрешимо относительно вектора G.

К2. Преобразование S должно удовлетворять как равенству (3), так и соотношению  .

.

К3. Каноническая форма должна быть пригодной для синтеза адаптивных алгоритмов настройки векторов G и D.

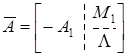

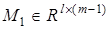

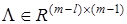

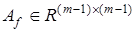

Можно показать, что условиям К1, К2 удовлетворяет матрица  , имеющая следующее каноническое представление на множестве

, имеющая следующее каноническое представление на множестве  :

:

, (6)

, (6)

где  — вектор параметров,

— вектор параметров,  ,

,  — некоторые постоянные матрицы.

— некоторые постоянные матрицы.

В адаптивных системах наиболее широкое распространение получили следующие два представления для матрицы  , являющиеся частным случаем (6):

, являющиеся частным случаем (6):

а) выходная каноническая форма (минимальная реализация)

; (7)

; (7)

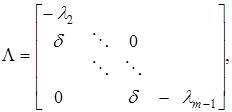

б) форма с  и

и  вида (неминимальная реализация)

вида (неминимальная реализация)

,

,  (8)

(8)

где d — символ Кронекера.

В случае б) вектор  и матрица L подбираются так, чтобы пара

и матрица L подбираются так, чтобы пара  была наблюдаемой.

была наблюдаемой.

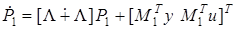

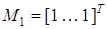

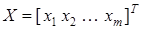

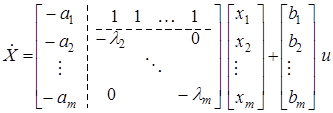

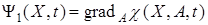

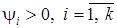

Для восстановления вектора  и ненаблюдаемого вектора состояния

и ненаблюдаемого вектора состояния  в (5) по данным

в (5) по данным  применяются адаптивные наблюдатели. Каждому из приведенных выше идентификационных представлений соответствует свой АН, получаемый из (5). Так для матрицы (7) адаптивный наблюдатель явного типа имеет вид (5) с векторами

применяются адаптивные наблюдатели. Каждому из приведенных выше идентификационных представлений соответствует свой АН, получаемый из (5). Так для матрицы (7) адаптивный наблюдатель явного типа имеет вид (5) с векторами

,

,  ,

,

где  ,

,  — m-мерные настраиваемые векторы параметров наблюдателя,

— m-мерные настраиваемые векторы параметров наблюдателя,  — вектор параметров матрицы K.

— вектор параметров матрицы K.

Вектор  (вектор обратной связи) вводится для обеспечения асимптотической устойчивости АН в случае представления (7). Для построения адаптивного наблюдателя (5) используются вспомогательные сигналы, которые получаются путем пропускания сигналов

(вектор обратной связи) вводится для обеспечения асимптотической устойчивости АН в случае представления (7). Для построения адаптивного наблюдателя (5) используются вспомогательные сигналы, которые получаются путем пропускания сигналов  ,

,  через систему (фильтры состояния)

через систему (фильтры состояния)

,

,  ,

,

где  — гурвицева матрица,

— гурвицева матрица,  — вектор вспомогательных сигналов,

— вектор вспомогательных сигналов,  — некоторый постоянный вектор.

— некоторый постоянный вектор.

АН явного не получил широкого распространения, что связано с необходимостью выбора вектора обратной связи. В системах управления чаще применяются адаптивные наблюдатели неявного типа. Им соответствует каноническая форма с матрицей L и вектором  типа (8). Преимущество АН неявного типа состоит в том, что для описания системы (1) порядка m можно использовать обобщенное уравнение первого порядка относительно выхода

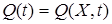

типа (8). Преимущество АН неявного типа состоит в том, что для описания системы (1) порядка m можно использовать обобщенное уравнение первого порядка относительно выхода  . Такому описанию системы (1) соответствует модель с обобщенным входом

. Такому описанию системы (1) соответствует модель с обобщенным входом

, (9)

, (9)

, (10)

, (10)

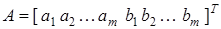

где  — вектор параметров,

— вектор параметров,  — обобщенный вход,

— обобщенный вход,  ,

,  ,

,  — вектор вспомогательных сигналов, получаемый на основе преобразования

— вектор вспомогательных сигналов, получаемый на основе преобразования  и

и  ,

,  — знак прямой суммы матриц.

— знак прямой суммы матриц.

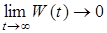

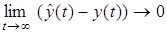

Для восстановления вектора параметров  и обеспечения условия

и обеспечения условия

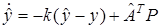

применяется адаптивный наблюдатель неявного типа

, (11)

, (11)

где  — некоторое число (эталонная модель),

— некоторое число (эталонная модель),  — вектор настраиваемых параметров,

— вектор настраиваемых параметров,  выход наблюдателя.

выход наблюдателя.

1.3. Приведение уравнения (1) к идентификационной

форме (9), (10)

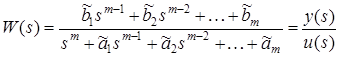

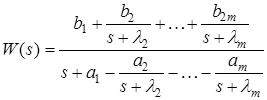

Опишем способ получения адаптивного наблюдателя Людерса-Нарендры (неминимальная реализация для матрицы  ). Передаточную функцию системы (1) представим в виде

). Передаточную функцию системы (1) представим в виде

. (12)

. (12)

Разделим числитель и знаменатель (П7.1) на полином  , где

, где  ,

,  ,

,  . Тогда

. Тогда  можно привести к виду

можно привести к виду

. (13)

. (13)

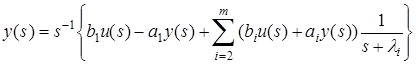

Подставляя (13) в (12) после несложных преобразований для  получим

получим

. (14)

. (14)

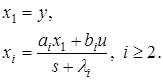

Чтобы записать это уравнение в пространстве состояний, введем обозначения

(15)

(15)

Положим

,

,  ,

,  .

.

Тогда идентификационное представление будет иметь вид

. (16)

. (16)

Переменные состояния системы (16) вычисляются в соответствии с (15). От уравнения (15) нетрудно перейти к модели с обобщенным входом (9), (10). Для этого достаточно положить

,

,  ,

,  ,

,

.

.

В данном случае переменные состояния системы будут определяться путем решения алгебраических уравнений

.

.

Описанный подход, основанный на применении операционного метода, можно применить и для получения идентификационного представления для нестационарных систем. Но при этом необходимо учитывать, что

,

,

где  .

.

Перейдем теперь к вопросам идентификации динамических систем, приведенных к идентификационной форме (9), (10). Изложим сначала метод непрерывных  -алгоритмов.

-алгоритмов.

2. Метод непрерывных  -алгоритмов

-алгоритмов

Непрерывный случай

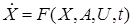

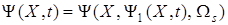

Рассмотрим задачу идентификации объекта

, (17)

, (17)

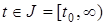

где  — вектор состояния;

— вектор состояния;  — вектор параметров, принадлежащий некоторой ограниченной, но априори неизвестной области

— вектор параметров, принадлежащий некоторой ограниченной, но априори неизвестной области  ;

;  — вектор управления (входа);

— вектор управления (входа);  ;

;  — непрерывно дифференцируемая по X, A, U вектор-функция.

— непрерывно дифференцируемая по X, A, U вектор-функция.

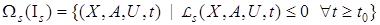

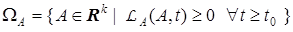

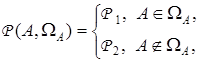

Под объектом будем понимать обобщенный настраиваемый объект, включающий в себя собственно объект и настраиваемую модель. На объект наложены ограничения, которые в отличие от (18) формируются на основе информации  , получаемой в результате анализа множества

, получаемой в результате анализа множества  при заданном уровне априорных данных

при заданном уровне априорных данных  ,

,

, (18)

, (18)

В процессе решения задачи идентификации область  может уточняться и трансформироваться, что отражено зависимостью от t в (18).

может уточняться и трансформироваться, что отражено зависимостью от t в (18).

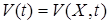

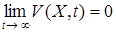

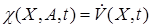

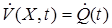

На движения системы рассматривается функционал  (функция Ляпунова), характеризующая качество работы системы. Под целью управления понимается выполнение условия

(функция Ляпунова), характеризующая качество работы системы. Под целью управления понимается выполнение условия

. (19)

. (19)

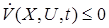

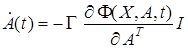

Для обеспечения (19) алгоритм принятия решений (адаптации, управления)  должен выбираться таким, чтобы обеспечить выполнение условия

должен выбираться таким, чтобы обеспечить выполнение условия

. (20)

. (20)

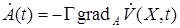

Задача сводится к выбору такого алгоритма настройки параметров обобщенного объекта

, (21)

, (21)

где A — искомый оператор, чтобы на движениях системы (17) при наличии ограничений (18) выполнялось целевое условие (19) или более слабое условие (20).

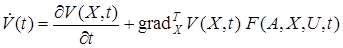

Рассмотрим сначала случай координатных ограничений. Найдем производную по времени от  с учетом (17)

с учетом (17)

.

.

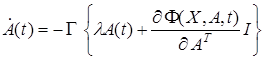

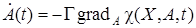

При отсутствии ограничений из условия (20) алгоритм скоростного градиента

, (22)

, (22)

(  — симметрическая положительно определенная матрица), учет области

— симметрическая положительно определенная матрица), учет области  приводит к более сложному алгоритму идентификации. Чтобы найти его, поступим следующим образом.

приводит к более сложному алгоритму идентификации. Чтобы найти его, поступим следующим образом.

1. Осуществим расщепление функции  на два вектора, один из которых не зависит, а второй зависит от

на два вектора, один из которых не зависит, а второй зависит от  . Для объектов, линейных по A, первый сомножитель будет иметь вид

. Для объектов, линейных по A, первый сомножитель будет иметь вид

(таким путем ищется алгоритм скоростного градиента (22)). В случае нелинейной зависимости  от А такое расщепление осуществляется исходя из вида функции

от А такое расщепление осуществляется исходя из вида функции  и полученная составляющая обозначается через

и полученная составляющая обозначается через  . Итак, имеем

. Итак, имеем

,

,

где  — некоторая вектор-функция.

— некоторая вектор-функция.

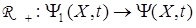

2. Следующий этап состоит в учете ограничений. Для этого осуществляется преобразование вектора  в Y и функция

в Y и функция  приводится к так называемому F-представлению

приводится к так называемому F-представлению

, (23)

, (23)

где  — некоторая положительная вектор-функция (то есть вектор, у которого

— некоторая положительная вектор-функция (то есть вектор, у которого  ),

),  — непрерывно дифференцируемая по А вектор-функция.

— непрерывно дифференцируемая по А вектор-функция.

Вектор  в обобщенном виде отражает ограничения, накладываемые на объект. Он конструируется исходя из вектор-функции

в обобщенном виде отражает ограничения, накладываемые на объект. Он конструируется исходя из вектор-функции  с учетом области

с учетом области  (18), то есть

(18), то есть

.

.

Таким образом, учет ограничений  приводит к такому преобразованию вектор-функции

приводит к такому преобразованию вектор-функции  , чтобы вектор-функция

, чтобы вектор-функция  была положительной

была положительной

. (24)

. (24)

Обеспечение положительности вектора  объясняется применением метода функций Ляпунова и условиями реализации множества

объясняется применением метода функций Ляпунова и условиями реализации множества  . Если область

. Если область  является открытой, то есть на объект не наложено ограничений, то преобразование

является открытой, то есть на объект не наложено ограничений, то преобразование  является таким, что

является таким, что

,

,

где  — единичный вектор.

— единичный вектор.

В результате применения преобразования (24) к  вектор-функция

вектор-функция  также приводится к некоторой вектор-функции

также приводится к некоторой вектор-функции  , вид которой полностью определяется множеством

, вид которой полностью определяется множеством  ,

,

. (25)

. (25)

Так как  , то для обеспечения условия

, то для обеспечения условия  , соответствующего достижению целевого условия (19), достаточно применить следующий алгоритм идентификации

, соответствующего достижению целевого условия (19), достаточно применить следующий алгоритм идентификации

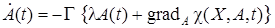

, (26)

, (26)

где  — положительно определенная симметрическая матрица.

— положительно определенная симметрическая матрица.

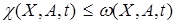

Назовем (26) адаптивным j-алгоритмом. Как следует из (25), свойства адаптивного j-алгоритма полностью определяются ограничениями, накладываемыми на объект. Что качается ограничений на помеху  , то они отражаются с помощью условия

, то они отражаются с помощью условия  .

.

Если на функцию  наложить функциональное ограничение

наложить функциональное ограничение

,

,

где  — квадратичная форма от

— квадратичная форма от  , зависящая от

, зависящая от  , то по аналогии с (26) получим адаптивный алгоритм вида

, то по аналогии с (26) получим адаптивный алгоритм вида

, (27)

, (27)

где  .

.

Назовем уравнение (27) пропорционально-интегральным j-алгоритмом.

Полученные законы описывают широкий класс алгоритмов идентификации. Если функция  является линейной по вектору настраиваемых параметров

является линейной по вектору настраиваемых параметров  , то для большинства практических случаев

, то для большинства практических случаев  будет зависеть от псевдоградиента функции

будет зависеть от псевдоградиента функции  . При этом функция

. При этом функция  должна принадлежать классу H .

должна принадлежать классу H .

Определение 5.1. Будем говорить, что вектор-функция  , если:

, если:

1) она является непрерывно дифференцируемой по вектору А

,

,

где  — матрица Якоби;

— матрица Якоби;

2) матрица  является такой, что вектор

является такой, что вектор  является неотрицательным

является неотрицательным

.

.

Последнее условие обобщает условие псевдоградиентности на векторный случай.

Итак, если функция  является линейной по A, то из (26) и (27) можно получить класс непрерывных псевдоградиентных алгоритмов идентификации. Для данного класса алгоритмов условие устойчивости записывается в виде

является линейной по A, то из (26) и (27) можно получить класс непрерывных псевдоградиентных алгоритмов идентификации. Для данного класса алгоритмов условие устойчивости записывается в виде

.

.

Другим частным случаем, следующим из (26) и (27), является класс алгоритмов скоростного градиента

, (28)

, (28)

. (29)

. (29)

Уравнение (29) представляет собой регуляризованный вариант алгоритма (28).

Изложенная методология синтеза применима как в случае ограничений, накладываемых на вход, выход (действующую помеху), так и вектор параметров объекта

,

,

где  — нелинейный оператор.

— нелинейный оператор.

В задачах идентификации в качестве  чаще всего используется норма вектора А в пространстве

чаще всего используется норма вектора А в пространстве  . Как и в случае (18), учет ограничений

. Как и в случае (18), учет ограничений  приводит к F-представлению (23), но в отличие от изложенного выше вектор-функция Y будет зависеть от вектора

приводит к F-представлению (23), но в отличие от изложенного выше вектор-функция Y будет зависеть от вектора  . Несмотря на это к

. Несмотря на это к  предъявляются те же требования, что и при учете области

предъявляются те же требования, что и при учете области  .

.

Учет множества  имеет свою специфику, которая, естественно, отразится на классе получаемых алгоритмов. При

имеет свою специфику, которая, естественно, отразится на классе получаемых алгоритмов. При  адаптивный алгоритм записывается в виде

адаптивный алгоритм записывается в виде

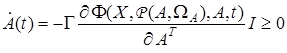

. (30)

. (30)

Матрица  играет роль индикатора принадлежности и имеет вид

играет роль индикатора принадлежности и имеет вид

где  ,

,  — некоторые матрицы, конструируемые на основе множества

— некоторые матрицы, конструируемые на основе множества  . В частности,

. В частности,  ,

,  , где

, где  ,

,  — соответственно единичная и нулевая матрицы. В общем случае

— соответственно единичная и нулевая матрицы. В общем случае  является функцией k-значной логики.

является функцией k-значной логики.

В отличие от закона (26) нелинейность алгоритма (30) проявляется в зависимости вектора  от матрицы

от матрицы  .

.

Заметим, что в качестве  при синтезе j-алгоритмов могут использоваться как локальные, так и интегральные функционалы. В локальном случае для функционала

при синтезе j-алгоритмов могут использоваться как локальные, так и интегральные функционалы. В локальном случае для функционала  имеем

имеем  , а в случае интегрального функционала

, а в случае интегрального функционала  равно подынтегральной функции.

равно подынтегральной функции.

Дата добавления: 2017-02-13; просмотров: 1618;