Метод конечных разностей

Метод конечных разностей – самый старый метод решения краевых задач. Производная функции заменяется отношением разности ее значений при малом изменении аргумента к изменению аргумента. Например, для функции y(x) на отрезке (одномерная задача), пользуясь разложением по формуле Тейлора, можно записать:

,

,

где h – малое изменение аргумента, в данном случае x. Проще всего понять суть метода на примере. Пусть требуется найти решение уравнения (значение функции j при заданном X):

,

,

удовлетворяющего следующим граничным условиям (ГУ) или значениям на границах исследуемой области (0 £ X £ 1):

j(х=0) = 0;

j(x=1) = 1.

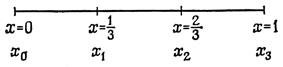

Разбиваем область определения от 0 до 1 на 3 элемента. Иными словами, шаг сетки h равен h=1/3.

Заменяя вторую производную в дифференциальном уравнении ее аппроксимацией по формуле Тейлора, для i-го узла получаем:

|

| ¯ |

|

или, после приведения подобных

.

.

Используя это уравнение, для узлов i=1 и i=2 можно записать систему линейных алгебраических уравнений:

(i=1)

(i=1)

(i=2)

(i=2)

Подставляя значения граничных условий: j0=0 и j3=1, получаем итоговую систему алгебраических уравнений:

| à |

|

| à |

|

Ее решение: j1=0.2893 и j2=0.6107. Точное решение: j1=0.2889 и j2=0.6102.

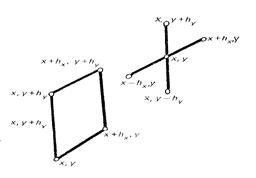

Аналогичным образом можно решать задачи и в 2-, 3-мерных областях. Например, для двухмерной задачи отдельно аппроксимируются производные по X и Y. Для этого используются следующие «шаблоны»:

К преимуществам метода конечных разностей можно отнести возможность относительно просто (для профессионала) решать сколь угодно сложные задачи. К недостаткам – сложность задания неравномерной сетки в исследуемой области и проблемы задания ГУ на границах, непараллельных осям координат.

Дата добавления: 2017-09-01; просмотров: 831;